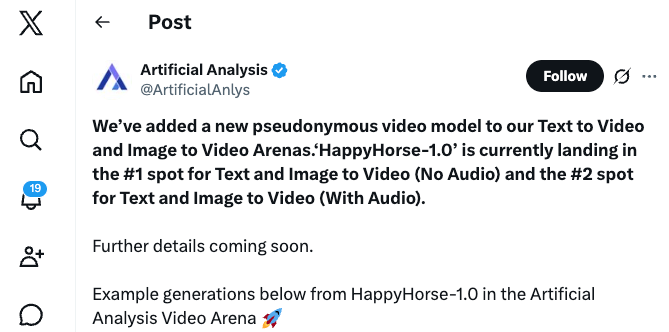

上周,一个我从未见过的名字同时占据了文本转视频和图像转视频排行榜的榜首。HappyHorse-1.0。没有已知的团队,也没有品牌。GitHub 和 HuggingFace 上的链接都显示“即将推出”。

如果你在将视频模型整合到流程之前对其进行评估——并且你已经学会对排行榜的炒作持怀疑态度——那么这就是对哪些内容已被证实、哪些内容只是声称以及这两者之间的差距对当前决策意味着什么的分析。

HappyHorse-1.0是如何进入人们视野的

人工智能分析视频竞技场:排行榜是什么以及它为何重要

人工智能分析平台运行在一个视频竞技场中。用户提交文本提示或参考图像。系统会生成两个模型的输出结果。用户并排查看这两个结果,并不知道哪个模型生成了哪个结果,然后选择自己更喜欢的那个。

这些投票结果会被纳入 Elo 等级分系统——其计算方法与国际象棋排名相同。当用户选择某个模型时,该模型的得分就会上升;当用户不选择该模型时,其得分就会下降,并根据对手的实力进行调整。最终的排名完全基于用户在盲测条件下的总体偏好。没有经过精心挑选的实验室提交结果,也没有用户自行报告的基准数据。

盲评用户和 Elo 评分:并非自我报告的基准

我见过的其他所有视频模型排名都存在同样的问题——给出排名数据的人正是模型的开发者。而人工分析则消除了这个问题。质量信号完全来自那些并不了解自己投票内容的用户。

Elo评分差异是相对的。60分的差距意味着一个模型在正面交锋中大约能赢58-59%。5分的差距则几乎可以忽略不计。

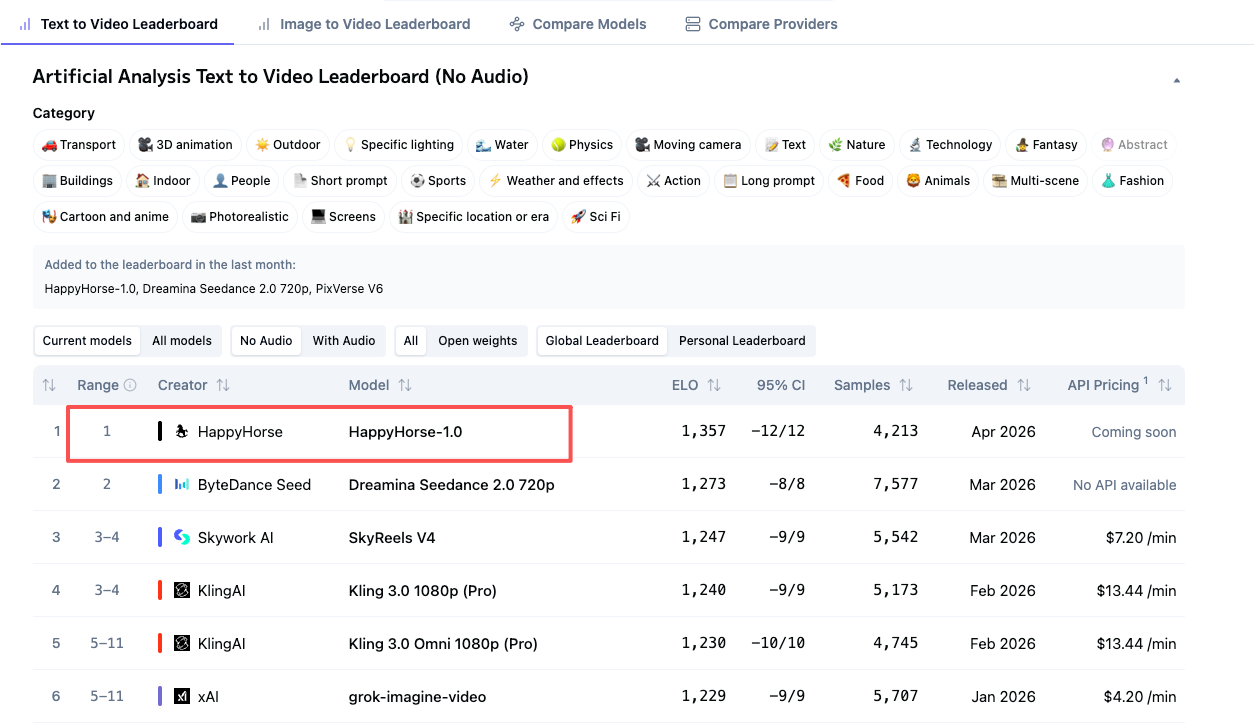

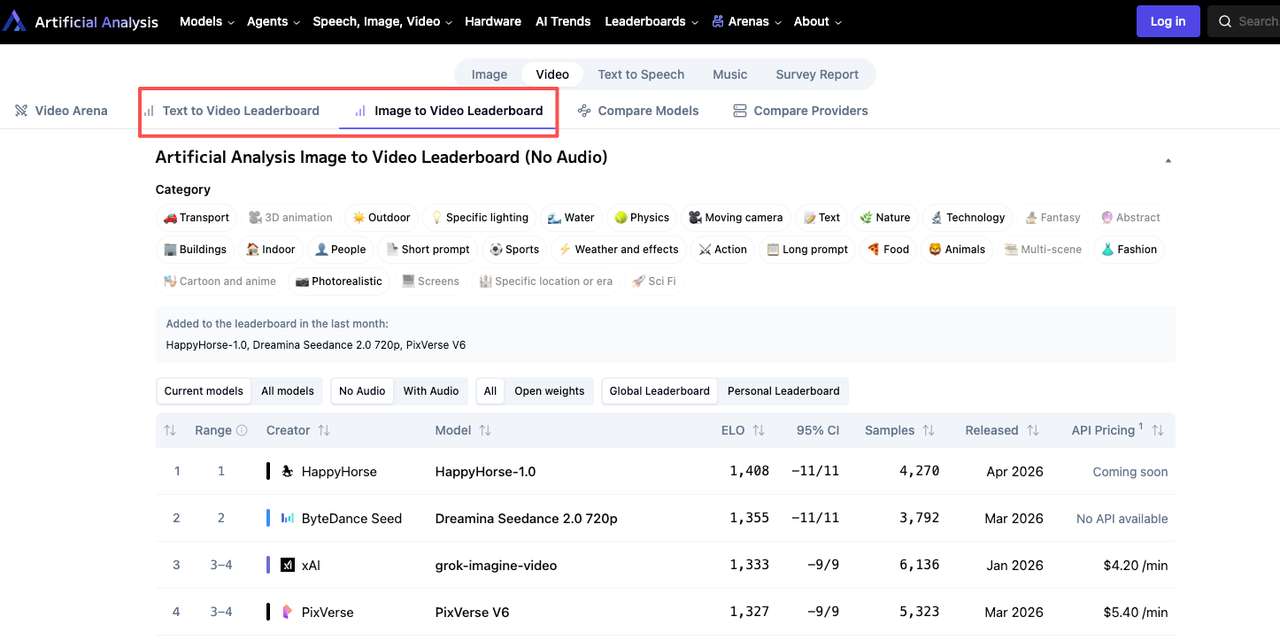

T2V排名第一(Elo等级1333),I2V排名第一(Elo等级1392)——这些数字在上下文中的含义是什么?

截至2026年4月初,HappyHorse-1.0在人工智能分析排行榜上的排名:

| 类别 | 埃洛 | 秩 |

|---|---|---|

| 文本转视频(无音频) | 1333 | #1 |

| 图像转视频(无音频) | 1392 | #1 |

| 文本转视频(带音频) | 1205 | #2 |

| 图像转视频(带音频) | 1161 | #2 |

此前在无音频T2V类别中排名第一的是Dreamina Seedance 2.0,得分为1273分。60分的Elo差距可不小。在无音频I2V类别中,HappyHorse领先Seedance 2.0 37分。

加上音频后,情况就完全不同了——Seedance 2.0 以微弱优势击败 HappyHorse,夺得第一名。差距很小:在 T2V 音频模式下领先 14 分,在 I2V 音频模式下领先 1 分。

需要坦诚面对的一点是:新加入模型的 Elo 分数波动性比老模型更大。Seedance 2.0 在 T2V 类别中拥有超过 7500 个投票样本。HappyHorse 的样本数量尚未公开。随着更多投票的加入,这些数字将会发生变化,但变化的方向尚不明确。此外,这个结论并非绝对可靠——模型更新速度很快。

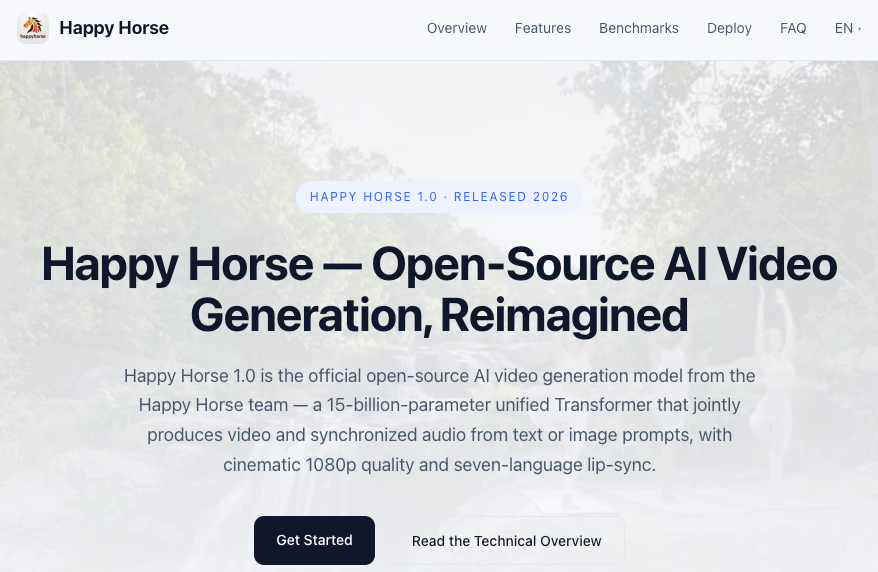

我们对这个模型的了解

我在此提前说明,因为截至本文发布日期(2026 年 4 月 8 日),这些技术声明均未经过第三方独立验证。

单一自注意力Transformer架构,40层设计(happyhorse-ai.com声称,未经证实)

该网站描述了一个包含 40 层的统一 Transformer 模型。文本标记、参考图像潜在层以及带噪声的视频和音频标记——据该网站称——在一个标记序列中被联合去噪。据称,前 4 层和后 4 层使用了特定模态的投影。中间 32 层在所有模态之间共享参数。没有使用交叉注意力机制。

另一个营销网站(happy-horse.art)声称拥有150亿个参数。但这个数字并未出现在主域名或任何独立报告中。

架构描述足够具体,可以被证伪——一旦权重可用,就会有人在几个小时内验证或反驳它。

多语言音视频生成:中文、英文、日文、韩文、德文、法文(据称)

该网站列出了六种原生支持的音视频联合生成语言:中文、英文、日文、韩文、德文和法文。happy-horse.art 页面还添加了粤语作为第七种,并提到了“超低词错误率唇音同步”。

我无法验证这些说法。没有权重数据,没有API,也没有可复现的演示。人工智能分析中显示的竞技场输出结果并没有系统地测试多语言音频能力。

(据报道)文本转视频和图像转视频在同一流程中实现

该网站描述了一个统一的流水线,可以同时处理 T2V 和 I2V 通信。这与排行榜数据一致——HappyHorse-1.0 在两个领域都以相同的模型名称出现,表明它是一个单一的模型,而不是两个独立的专用模型。

该网站还声称具备联合音频合成功能——对话、环境音效和拟音效果可与视频同时一次性生成。在“含音频”类别中排名第二表明,即使音频生成功能并非领先,但其音频生成能力依然存在且具有竞争力。

尚未核实的内容

团队身份:根据人工智能分析,使用化名,推测来自亚洲。

没有人公开声称对 HappyHorse-1.0 负责。人工智能分析公司在宣布该模型加入竞技场 时使用了“匿名”一词——这意味着它是在没有可验证的团队或组织的情况下提交的。

社区对X的猜测指向亚洲起源。理由部分基于其多语言能力(尤其突出的是中日韩语言),部分基于其发布时间模式与中国人工智能实验室以往的秘密发布方式相似。但这些都不能作为确凿的证据。对起源的猜测并不等同于对起源的确定。

开源声明:GitHub 和 HuggingFace 的链接标记为“即将推出”,截至发稿时尚无法访问。

happyhorse-ai.com 网站声明:“基础模型、精简模型、超分辨率模型和推理代码——全部发布。” 该网站还表示:“一切都是开源的。”

截至2026年4月8日,该网站上的GitHub链接和模型中心链接均显示“即将推出”,但实际上并没有任何链接指向任何地方。我在HuggingFace和GitHub上搜索了HappyHorse的权重,但一无所获。

网站上说所有内容都已发布,但链接却显示并非如此。这与文档不符。

参数数量和硬件要求:未经独立证实

150亿参数的说法出现在一个辅助网站(happy-horse.art)上,而非主网站。主网站提到了推理速度——在256p分辨率下,5秒视频片段的推理时间约为2秒;在H100编码下,1080p视频片段的推理时间约为38秒——但这些数据是厂商自行公布的。目前尚无第三方机构发布关于推理速度或内存需求的独立基准测试结果。

如果没有可下载的权重数据,模型创建者以外的人就无法验证参数数量、架构细节或硬件要求。我的数据仅限于此。

WAN 2.7 的猜测:其驱动因素是什么?为何仍未得到证实?

一些社区成员猜测 HappyHorse-1.0 实际上是 WAN 2.7——阿里巴巴 WAN 视频模型系列的下一个版本——在正式发布前以化名进行测试。

逻辑是这样的:WAN 2.6 在人工智能分析排行榜上,T2V 的 Elo 评分为 1189(远低于 HappyHorse)。在正式发布前匿名发布模型已成为中国人工智能生态系统的一种模式。2026年 2 月的 Pony Alpha 事件就是最明显的先例——一个神秘模型出现在 OpenRouter 上,引发了一场猜测,最终证实是 Z.ai 的 GLM-5 在进行秘密压力测试。

但相似模式并不能证明同一性。HappyHorse 网站上的架构描述与公开的广域网架构明显不符。没有泄露的权重,没有 API 指纹,也没有内部人士证实两者之间存在关联。我不知道。但总比胡编乱造强。

为什么“神秘起源”与建筑商息息相关

Elo评分系统并不看重团队身份——质量信号是真实存在的。

那些投票认为 HappyHorse 的输出结果优于 Seedance 2.0 和 Kling 3.0 的用户,并不知道自己投票支持的是什么。如果一个模型在盲测中持续胜出,这就能真正说明其输出质量有其优势——而与模型的开发者无关。

质量信号并不取决于是否了解团队,而取决于是否信任方法论。

访问不确定性:目前没有稳定的 API 或公开权重

信号质量和实际可用性是两回事。截至目前:没有公开的API,没有可下载的权重数据,没有公开的定价信息,也没有服务级别协议(SLA)。

对于任何正在构建产品线或发布产品的人来说,HappyHorse-1.0 目前还不是一个可行的选择。排行榜排名是真实的,但访问权限尚未实现。

值得关注的内容:GitHub 发布、权重可用性、API 访问信号

有三件事能让 HappyHorse 从“排行榜参赛者”变成“真正的选择”:一个包含实际权重和推理代码的 GitHub 存储库,一张包含可验证详细信息和许可证的 HuggingFace 模型卡,或者一个包含已记录定价的 API 端点。

截至撰写本文时,尚无此类产品。

它在当前视频模式格局中的定位

当前T2V和I2V排行榜背景

2026年4月初,人工智能分析T2V排行榜榜首(无音频):

| 秩 | 模型 | 埃洛 | API可用 | 已发布 |

|---|---|---|---|---|

| #1 | 快乐马-1.0 | 1333 | 不 | 2026年4月 |

| #2 | Seedance 2.0 720p | 1273 | 没有公共 API | 2026年3月 |

| #3 | SkyReels V4 | 1245 | 是的(7.20美元/分钟) | 2026年3月 |

| #4 | Kling 3.0 1080p Pro | 1241 | 是的(13.44美元/分钟) | 2026年2月 |

| #5 | PixVerse V6 | 1240 | 是的(5.40美元/分钟) | 2026年3月 |

I2V(无音频)遵循相同的模式:HappyHorse 排名第 1,392,Seedance 2.0 排名第 1,355,PixVerse V6 排名第 1,338,Grok Imagine Video 排名第 1,333,Kling 3.0 Omni 排名第 1,297。

Elo 排名最高的两个模型——HappyHorse 和 Seedance 2.0——均无法通过公共 API 访问。T2V 排名第 3 至第 5 的选手 Elo 分数相差 5 分,属于统计学上的平局。

为什么这对评估视频生成技术栈的团队至关重要

这是两个独立的问题。哪个模型能产生最佳的盲测结果?根据现有数据,HappyHorse-1.0 是最佳选择。哪个模型目前可以实际集成?HappyHorse 不是。

实际排行榜从第3名开始。SkyReels V4在现有选项中拥有最佳的性价比。Kling 3.0 Pro价格更高,但原生支持1080p分辨率。PixVerse V6是顶级产品中每分钟价格最低的。

如果 HappyHorse 在未来几周内发布权重数据或 API,情况就会发生变化。这并非不可能——今年已经多次出现先隐瞒后发布的先发布后正式发布的策略。当然,也可能几个月内都不会有任何新内容。

常问问题

HappyHorse-1.0 是谁开发的?

未知。人工智能分析将其描述为“化名”。社区猜测指向一个位于亚洲的团队,但没有任何组织声称拥有该团队的所有权。

HappyHorse-1.0 现在可以使用了吗?

目前尚未达到可投入生产使用的程度。GitHub 和模型中心链接均显示“即将推出”。截至 2026 年 4 月 8 日,既没有公开 API,也没有可下载的权重文件,更没有公布定价信息。

HappyHorse-1.0 与 WAN 2.7 相同吗?

未经证实。之所以存在这种猜测,是因为匿名预发布产品在中国人工智能生态系统中很常见——最近的例子就是小马宝莉Alpha/GLM-5 。目前没有直接证据表明HappyHorse与阿里巴巴的WAN系列产品有关。

人工智能分析如何对视频模型进行排名?

盲选投票。用户在不知道视频出自哪位模特的情况下,比较同一提示中的两个视频,然后选择自己更喜欢的一款。投票结果将纳入 Elo 评分系统。

HappyHorse-1.0 的权重何时发布?

未给出具体时间表。GitHub 和 Model Hub 都显示“即将推出”。没有任何公开承诺可供约束。

排行榜上的数字是真实的。其他所有信息——包括队伍、体重、访问权限和时间安排——都还在核实中。